基于人民日报新闻阅读的增强现实应用研究

摘要:增强现实(Augmented Reality,AR)技术为传统媒体与新兴媒体的融合带来了新的创新思路。基于AR技术,设计一款APP,通过APP实现传统媒体与新兴媒体在内容和传播形态上的融合创新,读者在阅读新闻报纸或杂志时,通过APP扫描感兴趣的内容,即可实现富媒体的扩展,根据内容展现AR视频、3D模型、语音文字交流或图像百科等。以AR技术作为媒体融合的切入点,打破了传统媒体与新兴媒体之间由于传播介质造成的堡垒,带来阅听习惯的革新。

关键字:增强现实 媒体融合 阅读 富媒体

引言

媒体融合是近几年新闻传播业使用频率很高的词。中央政府作出“推动传统媒体与新兴媒体融合发展”的发展战略[1],即促进报网互动、报网融合,媒体融合进而成为新闻业的发展大势。媒体融合是新闻组织管理的融合,也是内容、传播和互动的融合。以人民网为例,人民网是世界十大报纸之一,为中国共产党中央委员会机关报,《人民日报》一贯坚持高品位、高格调的报道政治、经济、法律、新闻和科学文化知识等方面的资料,以其专业性和权威性吸引着众多读者,2012年与2014年《人民日报》日发行量均280万份,仅次于新华社主办的《参考消息》340万份的日发行量。《人民日报》作为国内最具代表性的报纸,在媒体融合方面也在不断的探索中,《人民日报》与其下属的人民网在新闻来源、处理、存储等采取一体化共享机制,在新闻栏目、版面等共建合作模式,实现了内容层面的融合。而对于新闻来说,传播形态的创新更有突破点与吸引力。传统媒体与新兴媒体在搭载介质上的不同,形成了一道媒体融合的堡垒。《人民日报》以二维码技术进行突破,使得报网之间有了互动,本文将介绍一种以增强现实技术为基础的新闻APP架构,用新技术实现媒体的内容与传播形态的融合创新。

1 解决方案

1.1 增强现实技术

阿尔托在他的知名著作《戏剧及其重影(The Theatre and Its Double)》(1938)中首次提出“虚拟现实”一词,阿尔托将剧院描述为“虚拟现实(Virtual Reality)”[2]。近半个世纪之后,现代意义上的虚拟现实逐渐向大众普及, 1990年美国波音公司的Caudell与同事在设计辅助布线系统[3]时提出了“Augmented Reality”的概念,在该布线系统中,使用光学透视式头盔显示器(Optical see-through head-mounted display,后简称S-HMD)实时的叠加简单线条绘制的布线路径和文字提示信息,以降低拆卸的复杂程度。

增强现实技术的目的是丰富现实世界,将虚拟对象融合在现实环境中,再通过AR显示器展示。它使用计算机计算生成虚拟对象(视频、模型、图片等富媒体信息),与真实世界结合起来,构造一个虚实结合的场景空间,最终通过AR显示设备展现给用户,同时可以与虚拟对象进行实时交互。在虚实结合的过程中,要对虚拟对象的空间定位、视觉融合、物理融合以及交互方式等问题进行研究处理,解决环境的视觉一致性问题[4],包括几何一致性、运动一致性、光学效果一致性和渲染细节分配等。

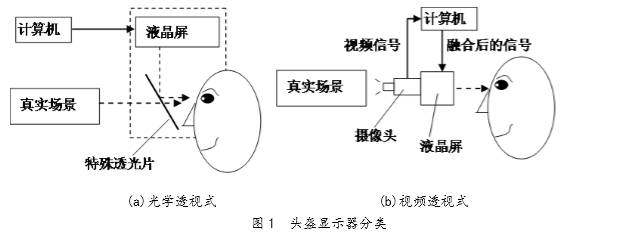

在增强现实系统中,用户AR的显示器选择比较灵活,包括头盔显示器(Head-Mounted Displays,HMD)(如图1所示)[5]、手持显示器(Head-held Displays)、投影显示器(Projection Displays)及普通的CRT或平面LCD显示器[6],在实际的应用中根据运用环境和任务的不同选取适用的显示设备。该实验研究过程中,采用了手持显示器,手持显示器是便携性较高的移动终端设备的显示器,一般来说,是通过摄像头实时的获取真实场景视频信息,通过后台的数据处理,将视频信息与虚拟对象融合,在显示屏中表现出来。移动终端设备可触控的特点,更有利于人机交互的设计。

1.2 增强现实技术应用进展

增强现实技术的研究在国内外的起步时间不同,导致了目前国内外不同的研究进度。在国外,增强现实已经在医学、遥操作、制造与维修、可视化及教育培训[7]、娱乐、军事训练等领域[8]取得了成功的应用。国内则更多的公司处于技术的研究开发阶段,主要是对于增强现实的关机技术及算法等进行研究,对于增强现实的应用处于起步阶段。

国内增强现实技术处于蓬勃发展的起步阶段。总部在上海的Realmax公司(纽约注册)是一家以 AR 硬件、底层算法、应用软件、内容制作以及开发者人才培养等几个层面来构建一个完整的 AR 生态的公司,打造“平台+内容+终端+应用”的生态链布局。目前Realmax已经发布了自己的6款硬件产品(包括两款智能眼镜、两款AR设备及两款工业级的产品)、自主研发的图像领域的AR算法(包括图像识别[9]、图像跟踪[10]及云端识别等)以及一套AR操作系统“Realcast”。视辰是一家成立于2012年的公司,公司致力于增强现实的核心技术开发及应用推广,目前投入市场的免费AR引擎―EasyAR 1.3.1,能够实现多目标跟踪,稳定性和准确性有提升,开发者可以以AR引擎作为基础进行业务级别的开发,为用户提供更多优质的应用。其他例如亮风台、小熊尼奥、央数文化等公司及个人也都在增强现实的不同应用领域取得了显著的成果。

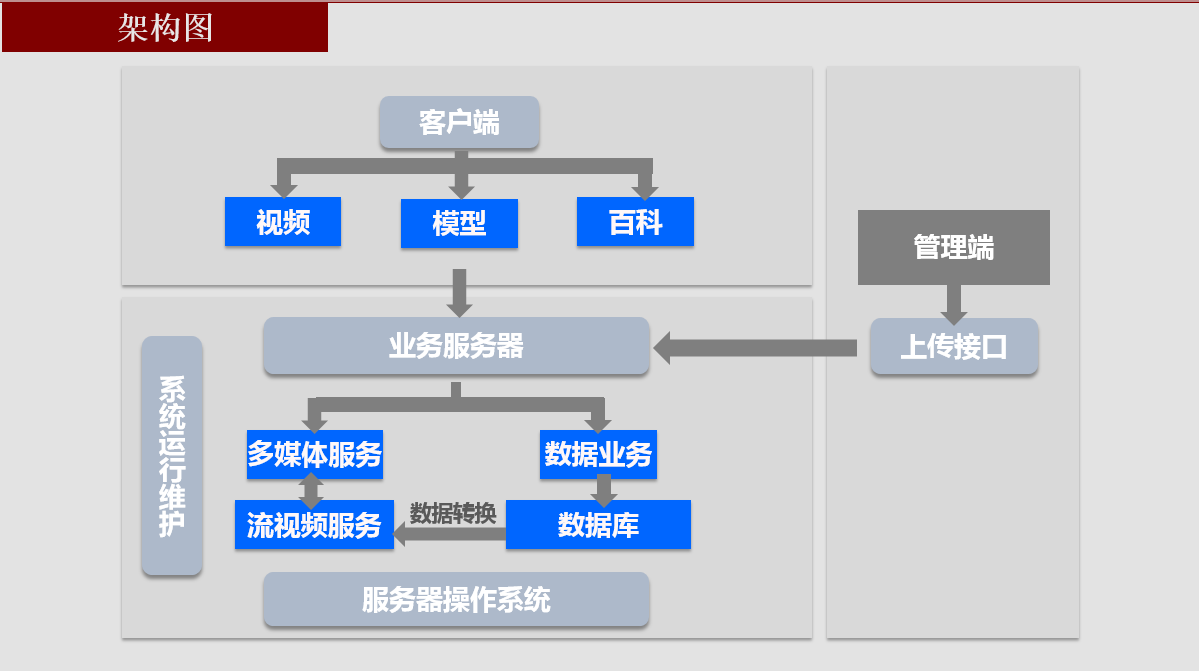

2 APP设计

系统根据功能与服务的不同划分为三个部分:客户端、管理端及业务服务器,如图2所示。新闻发布者使用管理端发布电子版的新闻,业务服务器调用图像处理算法进行标志物的特征识别标注与关联,并通过多媒体内容服务提供流媒体等,客户端根据需要扫描图片或纸质媒体,调用AR引擎识别出标志物的基本信息,根据信息从业务服务器申请到对应的多媒体资源并缓存到客户端,客户端可以进行信息的查看与互动。

图2 系统架构图

根据应用场景分析,APP的客户端开发设计了三类多媒体的表现形式,AR视频、AR模型及识图百科介绍。

AR视频:使用AR引擎识别并追踪现实场景中的标志物,将标志物的范围内的景象用对应的视频资源替换,视频追随标志物,随标志物的移动而移动,在阅读报纸杂志时对某一段文字或图片进行扫描即可得到生动的视频信息,或者对着电影海报可以在海报的位置看到动的预告片。

AR模型:APP扫描获取到标志物后,将模型吸附在标志物之上,可以多角度查看模型并与之互动,部分模型在查看时显示更多的附加信息。例如化学实验课的元素认知,少儿读物的教育等方面的扩展。

识图百科介绍:通过摄像头获取真实场景,对场景进行聚焦拍摄后,识别该图中的主体物体的信息,将对应的百科信息展示给用户。

3 APP的实现

3.1 EasyAR引擎

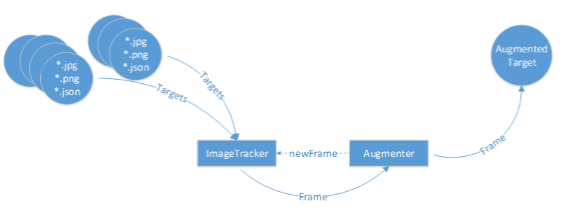

APP的开发使用EasyAR SDK作为AR引擎。EasyAR是一款由上海视辰信息发布的免费AR引擎。SDK开中包含图像识别技术、图像追踪技术、以及图像特征分析技术。使用该SDK可以自定义的生成Target对象(特征体),唯一的标示特征体,动态的加载Target并进行跟踪。如图3所示。

图3 EasyAR Target生成

SDK工作时首先加载图片,图图片生成Target,或者通过json格式的配置参数加载。生成Target后,将Target加载入ImageTracker用以跟踪。SDK采用异步的方式加载Target,所以更有利于C/S架构下的增强现实APP的开发。

3.2 APP的实现及结果

APP的模块集成在Android开发环境与Unity3D开发环境下,采用交叉开发编译的方式。Unity3D的使用可以更直观的对模型的细节等进行控制,Android开发环境下进行基本的UI设计。

APP主要使用AR引擎进行图像的处理及增强现实的表现,客户端调用AR camera扫描现实场景,通过与业务服务器的通信,识别出真实场景中的且在服务器中已存在的特征标志,同时获取到该特征标志的UID,客户端通过该UID从服务器中获取资源并使用AR的方式展现给用户,视频采用流媒体的方式,模型采用模型元数据+互动参数的方式下载到客户端,由客户端根据参数进行动态的加载。识别采用图像云识别技术,回调AR camera中的图像帧并上传识别,服务器进行识别处理并返回对应的百科结果,如图4所示。

图4 技术路线图

AR视频播放是从摄像头获取到真实场景,通过AR引擎(EasyAR)识别服务查找物所在的位置及相对于摄像头的角度(查找的参考物体为从数据库中自定义上传的目标体),根据目标体的特征标识,从业务服务器查找对应的流媒体视频资源,下载到客户端后,视频叠加在图像标记上,让用户感觉视频如同直接在图像上播放一样。用户可以选择两种方式播放,脱卡型播放和追踪型播放,脱卡型播放即扫描获取到视频信息后,系统根据视频的规格自动选定大小及位置进行播放,不需要移动设备的持续拍摄。追踪型播放为视频内容实时的根据图像标记的位置变化而改变,视频播放视图层的每一帧画面的显示,都会根据图像标记的大小位置进行重定位,使视频内容准确的叠加在图像标记上。实验结果如图5所示,一段关于企鹅的视频提前存储在服务器上,当扫描到背景中的企鹅图片时,APP会播放存储的视频,并在位置和角度上追随该图片。

3D模型交互,类似于AR视频播放,查找到特征标识,从服务器获取对应的模型资源及互动配置文件,在客户端可以通过虚拟热键、语音或物理按键的方式进行互动,较适合具有实体的文章报道,如科普新闻及广告等。实验结果如图6所示。当扫描到该张松鼠图片时,会在屏幕上浮现一只松鼠的模型,点击语音按钮下达指令,松鼠会做相应的动作。

图6 模型演示

百科识别功能,是为系统的改良而进行的一个实验功能,主要用于测试图像识别能力,实验项目中,该功能通过调用相机对现实场景进行扫描,通过云识别对该场景的特征进行分析,提取主体事物并获得文字描述的结果,比如对于奥巴马的演讲图片进行识别获得“奥巴马演讲”的文字结果,针对该结果进行相关联的多媒体信息搜索,并使用AR的形式表现。对新闻阅读领域,对场景进行粗略判断并推送关联度较高的新闻在技术上是可以实现的。实验结果如图7所示。扫描电脑屏幕上的小狗,点击屏幕获取帧后进行图像云识别, 返回了该品种小狗的百科资料。

|

分享让更多人看到

推荐阅读

相关新闻

- 评论

- 关注

第一时间为您推送权威资讯

第一时间为您推送权威资讯

报道全球 传播中国

报道全球 传播中国

关注人民网,传播正能量

关注人民网,传播正能量