РВОЕЧФ¶ЇРґЧчИфёЙјјКхСРѕї

ХЄТЄЈєОТГЗЖЪНы»ъЖчїЙТФПсИЛТ»СщЧ«РґёЯЦКБїµДРВОЕЈ¬ЛдИ»ДїЗ°УРГЅМеРыіЖТСѕКµПЦБЛРВОЕµДЧФ¶ЇЙъіЙЈ¬µ«ґу¶аКЗК№УГјИ¶ЁµДКэѕЭЈ¬¶ФИЛ№¤Йи¶ЁµДРВОЕДЈ°еЅшРРЧФ¶ЇМоідЈ¬ХвЦЦ·ЅКЅНШХ№РФЅПІоЈ¬ТІОЮ·ЁКµПЦЦЗДЬ»ЇЎЈХжХэµДЦЗДЬРВОЕРґЧчУ¦ёГїЙТФ»гЧЬєН№йДЙёш¶ЁКэѕЭєНРЕПўЈ¬ЧФ¶ЇІъЙъ·ыєППа№Ш±кЧјµДРВОЕЈ¬ЧФ¶ЇОД±ѕЙъіЙКЗКµПЦХвТ»Дї±кµД№ШјьјјКхЎЈ

±ѕОДµчСРБЛіЈУГµДЦЗДЬ»ЇЙъіЙОД±ѕµД·Ѕ·ЁЈ¬јшУЪОД±ѕКэѕЭѕЯУРРтБРРФµДМШµгЈ¬С»·ЙсѕНшВзФЪОД±ѕЙъіЙИООсЙПЧїУРіЙР§Ј¬іЈУГµДС»·ЙсѕНшВзДЈРНЦчТЄКЗLSTMЈ¬GRUЎЈ±ѕОДКЧПИ¶ФХвБЅёцДЈРНЅшРРБЛјтТЄЅйЙЬЈ¬И»єуУ¦УГХвБЅёцДЈРНµЅОД±ѕЙъіЙЦРЈ¬°ьАЁµД·Ѕ·ЁУРЈє1)Ѕ«СµБ·УпБПКэѕЭѕ№эУпСФДЈРНЙъіЙѕЯУРУпТеМШРФµД·ЦІјКЅґК±нКѕЈ¬ЧчОЄLSTM»тХЯGRUµДКдИлЈ¬СµБ·µГµЅЙсѕНшВзДЈРНЈ¬Ѕ«РВµДКэѕЭТІК№УГґК±нКѕµД·Ѕ·ЁКдИлµЅТСѕµГµЅµДДЈРНЦРЈ¬µГµЅРВµДОД±ѕКдіцЈ»2) К№УГЙо¶ИЙъіЙДЈРН±д·ЦЧФ±аВлЈ¬¶ФУпБПКэѕЭС§П°µЅТ»ёцЙъіЙДЈРНЈ¬К№УГёГЙъіЙДЈРНµГµЅРВµДОД±ѕКдіцЎЈЧоєуМбіцХвБЅЦЦ·Ѕ·ЁФЪКµјКУ¦УГЦРµДА§ДСЎЈ

№ШјьґКЈєРВОЕЧФ¶ЇРґЧчЈ¬ОД±ѕЧФ¶ЇЙъіЙЈ¬LSTM GRUЈ¬УпСФДЈРНЈ¬±д·ЦЧФ¶Ї±аВл

Т»Ўў СРѕї±іѕ°

1.1·ўХ№АъіМ

ЛщОЅЎ°»ъЖчРґЧчЎ±Ј¬УЦіЖЎ°»ъЖчИЛРґЧчЎ±Ј¬КЗЦёФЛУГЛг·Ё¶ФКдИл»тЛСјЇµДКэѕЭЧФ¶ЇЅшРРјУ№¤ґ¦АнЈ¬ґУ¶шЧФ¶ЇЙъіЙНкХыРВОЕ±ЁµАµДТ»ХыМЧјЖЛг»ъіМРт[1]Ј¬єЛРДФЪУЪЧФИ»УпСФЙъіЙЎЈЎ°»ъЖчРВОЕРґЧчЎ±ФтЦёУГХвЦЦјјКхЅшРРРВОЕРґЧчЈ¬КЗИЛ№¤ЦЗДЬС§їЖФЪРВОЕБмУтµДУ¦УГЎЈ

»ъЖчРґЧчТЄЧ·ЛЭµЅ 20 КАјН 50 ДкґъЈ¬ФґЧФ»ъЖчДЪИЭ·ТлµДСРѕїЎЈ 20 КАјН 60 ДкґъЈ¬ОЄБЛСйЦ¤Цё¶ЁµДУп·ЁАнВЫµДХэИ·РФєНЧЄ»»ЙъіЙУп·ЁµДУРР§РФЈ¬С§ХЯїЄКјСРѕїК№УГ»ъЖчЙъіЙУлЙППВОДОЮ№ШУп·ЁµДѕдЧУЈ»20 КАјН 70 ДкґъЈ¬јЖЛг»ъјјКхУ¦УГБмУтµДНШХ№ґЯ·ўБЛЖдЛыБмУт»ъЖчРґЧчµДСРѕїЈ¬ИзФЪУОП·ЦРАыУГ»ъЖчРґЧчЙъіЙУОП·ЛµГчОД±ѕЈ¬Н¬К±С§ХЯїЄКјіўКФ»ъЖчЙъіЙ№ВБўѕдєНёґКцЧФИ»УпСФЈ»20 КАјН 80 ДкґъЈ¬»ъЖчРґЧчјјКхµГµЅБЛН»·ЙГНЅшµД·ўХ№Ј¬ІўЦрІЅїЄКјУ¦УГУЪ¶ОВдЎўЖЄХВµДЙъіЙЈ¬ОД±ѕ№ж»®µДёЕДоКЧґОМбіцЈ»20 КАјН 90 ДкґъЈ¬ОД±ѕ№ж»®ЖчєНУпСФКµПЦЖчµДМбіцУлКµПЦґЩК№»ъЖчРґЧчїЄКјУ¦УГµЅёь¶аµДБмУтЦРЈ¬ИзФЪѕьКВЙПЙъіЙѕьКВ±ЁёжЈ¬ЖшПуѕЦЙъіЙМмЖшФ¤±ЁµИµИЈ»21КАјНіхЈ¬»ъЖчРґЧчјјКх»щ±ѕіЙКмЈ¬ёчёцБмУтТІїЄКјјУїмСРѕїІЅ·ҐЈ¬ФЪТЅБЖЎўРВОЕЎў ЅМУэµИБмУтїЄКјКµПЦ»ъЖчРґЧчПµНіЈ¬»ъЖчРВОЕРґЧчЙхЦБУЪН¶ИлКРіЎЈ¬¶ФРВОЕРРТµІъЙъБЛј«ґуµДіе»чУлМфХЅ[2]ЎЈИзЅсЈ¬ИЛ№¤ЦЗДЬФЪёчёцБмУтґу·ЕТмІКЈ¬РВОЕЅзТІІ»їЙ±ЬГвµДЅУКЬИЛ№¤ЦЗДЬµДЦШЛЬЈ¬ЖдЦРТФ»ъЖчИЛРґЧчЧоѕЯґъ±нРФЎЈЛжЧЕЙо¶ИС§П°µД·ўХ№Ј¬»ъЖчРґЧчµДРВОЕТІїЄКј±дµГёьјУ¶аФЄ»ЇЈ¬ёь·ыєПУГ»§µДРиЗуЎЈ

1.2№ъДЪНвµД·ўХ№ПЦЧґ

ґУ2010ДкЖрЈ¬РрКцїЖС§№«ЛѕїЄ·ўБЛТ»ёцГыОЄQuillµДПµНіЧ«РґБЛЎ°К®ґуБЄГЛЎ±КэЗ§ПоґуґуРЎРЎМеУэИьКВµДРВОЕЈ¬ЛьјёєхКЗФЪ±ИИьЦРЅшРРКµК±±ЁµАЈ¬ёејюІ»№ЬКЗФЪКэБї»№КЗК±Р§ЙП¶јФ¶і¬ТФНщЎЈОЄБЛёьєГµШ°СКэѕЭНЁ№эЛг·ЁЧЄ»ЇіЙОДЧЦЈ¬РрКцїЖС§№«Лѕ№НУ¶БЛТ»ЕъјЗХЯАґЎ°СµБ·Ў±јЖЛг»ъЈ¬К№ЖдДЬ№»ґУКэѕЭЦР·ўПЦёчЦЦёчСщµДЎ°ЅЗ¶ИЎ±Ј¬ІўЅМ»бјЖЛг»ъИзєОЧйЦЇОДХВµДЎ°јЬ№№Ў±ЎЈґЛНвЈ¬РрКцїЖС§№«ЛѕµДНЕ¶У»№ОЄїН»§МṩБЛ±ЁµАУпЖш·зёсµД¶аСщ»ЇСЎФсЎЈѕ№эјёДкµД·ўХ№Ј¬РрКцїЖС§№«ЛѕµДјјКхУРБЛёьЗїґуµДМбЙэЎЈ2014Дк3ФВЈ¬ёГ№«Лѕ·ўІјБЛQuill EngageЖЅМЁЈ¬ТІѕНКЗ№Иёи·ЦОцЈЁGoogle AnalyticsЈ©У¦УГЎЈ

№ъДЪГЅМеІЙУГ»ъЖчЧ«РґРВОЕёејюЖрІЅЅПНнЈ¬µ«єуРш·ўХ№КЖН·ЗїѕўЎЈ2015Дк11ФВЈ¬РВ»ЄЙзРыІјЎ°їм±КРЎРВЎ±Н¶ИлК№УГЈ¬ХвМЁ»ъЖчїЙТФїмЛЩНкіЙМеУэІЖѕАаµДРВОЕЧФ¶ЇРґЧчЎЈµ«ХвІўІ»КЗ№ъДЪµЪТ»ёцРґЧч»ъЖчИЛЎЈФзФЪ9ФВЈ¬МЪС¶ІЖѕ·ў±нµДТ»ЖЄМвОЄЎ¶8ФВCPIН¬±ИЙПХЗ2.0%ґґ12ёцФВРВёЯЎ·µДПыПўѕНУЙЧФ¶ЇРВОЕРґЧчИнјюDreamwriterНкіЙЈ¬ФЪТ»·ЦЦУДЪЅ«ЦШТЄРЕПўЅшРРЅв¶БІўЛНґпїН»§ЎЈФЪ2016ДкµДАпФј°ВФЛЙПЈ¬Т»ёцГыЅРXiaomingbotЈЁХЕРЎГчЈ©µД»ъЖчИЛїЄКјХёВ¶Н·ЅЗЎЈЎ°ХЕРЎГчЎ±µДєЛРДРґёеДЈїйУЙ±±ѕ©ґуС§јЖЛг»ъСРѕїЛщНтРЎѕьНЕ¶УєНЅсИХН·МхГЅМеКµСйКТБЄєПСР·ўЎЈХвКЗ№ъДЪµЪТ»їоїЙТФ±ЁµА°ВФЛИьКВµД»ъЖчИЛЈ¬ФЪЅбєПБЛЧоРВµДУпСФґ¦Ан»ъЖчС§П°єНКУѕхНјПсґ¦АнµДјјКхЦ®єуЈ¬НЁ№эУп·ЁєПіЙУлЕЕРтНкіЙРВОЕРґЧчЎЈФЪ°ВФЛ»бїЄКјєуµД13МмДЪЈ¬»ъЖчИЛЎ°ХЕРЎГчЎ±НЁ№э¶ФЅУ°ВЧйОЇµДКэѕЭївј°К±ёьРВРЕПўЈ¬ЕдСЎНјЖ¬Ј¬ФЪ¶МК±јдДЪНкіЙПыПўРґЧчєНИьКВ»гЧЬµИ№¤ЧчЈ¬№ІЧ«РґБЛ457ЖЄ№ШУЪУрГ«ЗтЎўЖ№ЕТЗтЎўНшЗтµДПыПўјтС¶єНИьКВ±ЁµАЈ¬ГїТ»ЖЄёејюЙъіЙµДК±јдґуФјКЗБЅГлЈ¬ГїМмїЙТФЧ«Рґ30ЖЄТФЙПЈ¬Жд·ўёеЛЩ¶ИјёєхУлµзКУЦ±ІҐН¬К±ЎЈ

1.3»ъЖчРВОЕРґЧчµДТвТе

»ъЖчРВОЕРґЧчЧчОЄТ»ЦЦРВµДЦЗДЬ№¤ЧчОЄРВОЕБмУтЧўИлБЛРВµД¶ЇБ¦Ј¬ЛьµДКµПЦі№µЧёД±дБЛґ«НіРВОЕёејюґґЧчµДДЈКЅЎЈ»ъЖчРґЧчЅ«ґъМжОТГЗИҐЦШёґЧ«Рґ»щ±ѕРВОЕёејюЈ¬јЗХЯёь¶аµШИҐЧцёьёЯЙоУРТвТеµД№¤ЧчЎЈ »ъЖчРґЧчЦчТЄУРТФПВјёёцУЕКЖґЩЅшРВОЕёејюµДґґЧчЈє

µЪТ»Ј¬КµК±їмЛЩЎЈДїЗ°Ј¬УЙУЪРВГЅМеµДіцПЦЈ¬РВОЕПыПўµДЛЩ¶ИµГµЅБЛєЬґуµДМбЙэЎЈЧчОЄРВОЕРРТµµДѕєХщХЯЈ¬РВОЕ±ЁµАµДїмЛЩєНКµК±іЙОЄХјБмН·МхµДЦШТЄ·Ё±¦ЎЈ

µЪ¶юЈ¬µНіЙ±ѕЎЈФЪРЕПўК±ґъЈ¬РВОЕ±ЁµАµДРиЗуБїІ»¶ПФцјУЈ¬µ«ґуБї±ЁµАµДЧ«РґЖдКµКЗТ»ЦЦ»ъРµРФµДЦШёґµД№¤ЧчЈ¬ХвґуґујУЦШБЛЧ«РґХЯµДёєµЈЈ¬АЛ·СБЛєЬ¶аµДАН¶ЇБ¦ЎЈ»ъЖчРВОЕРґЧчФЪТ»¶ЁіМ¶ИЙП°СИЛБ¦Ѕв·ЕіцАґЈ¬К№µГИЛГЗУРёь¶аµДѕ«Б¦ИҐЧцёьЦШТЄµДКВЗйЎЈ

µЪИэЈ¬їН№Ы№«ХэЎЈОгУ№ЦГТЙЈ¬ИЛФЪЧ«РґРВОЕёејюµДК±єт»бІ»їЙ±ЬГвµШ°СёцИЛµДЦч№ЫЗйёРґшИлЖдЦРЈ¬µјЦВИЛГЗ¶ФРВОЕёејюµДАнЅвіцПЦЖ«ІоЎЈ»ъЖчРВОЕРґЧчФЪТ»¶ЁіМ¶ИЙПїЙТФНкИ«ЧцµЅїН№ЫРФЈ¬ »ъЖчРВОЕРґЧчКµЦКЙПѕНКЗ¶ФРЕПўµДТ»ЦЦЅб№№»ЇКдіцЈ¬ХвСщґ«ґпµЅГсЦЪЙн±ЯµДРЕПўѕНКЗїН№Ы№«ХэµДЎЈ

¶юЎў РВОЕРґЧчПа№ШјјКх

2.1ЧФИ»УпСФЙъіЙ

ЧФИ»УпСФЙъіЙ°ьАЁОД±ѕµЅОД±ѕµДЙъіЙ(text-to-text generation)ЎўТвТеµЅОД±ѕµДЙъіЙ(meaning-to-text generation)ЎўКэѕЭµЅОД±ѕµДЙъіЙ(data-to-text generation) ТФј°НјПсµЅОД±ѕµДЙъіЙ(image-to-text generation)µИЈ¬РВОЕРґЧчµДєЛРДјјКхѕНКЗЧФИ»УпСФЙъіЙјјКх(NLG)Ј¬ЧФИ»УпСФЙъіЙЈЁNLGЈ©Т»Ц±ґ¦УЪИЛ№¤ЦЗДЬєНјЖЛгУпСФС§µДУ°ПмЦ®ПВЈ¬КфУЪЅ»ІжС§їЖЎЈТвФЪ№№ЅЁёЯР§µД»щУЪУпСФРЕПўґ¦АнµДјЖЛг»ъДЈРНЈ¬НЁ№эЅ«ійПуёЕДоєНТ»¶ЁµДУпТеЎўУп·Ё№жФтµДЅбєПАґЙъіЙОД±ѕЎЈѕµдµДЧФИ»УпСФЙъіЙДЈРН°ьАЁДЪИЭ№ж»®ЎўѕдЧУ№ж»®єН±нІгЙъіЙИэёц»щ±ѕ№¦ДЬДЈїй[3]Ј¬ФЪИЛ»ъ¶Ф»°Ўў»ъЖч·ТлЎўЧФ¶ЇХЄТЄµИЧФИ»УпСФґ¦АнИООсЦР¶јУРЧЕ№г·єµДУ¦УГЎЈ

ґ«НіµДЧФИ»ЙъіЙ·Ѕ·ЁТААµУЪ№жФтєНЧЁјТЈ¬ТЖЦІРФєЬІоЈ¬ЅьР©ДкЈ¬ёь¶аС§ХЯїЄКјК№УГЙсѕНшВзµД·Ѕ·Ёґ¦АнNLGИООсЈ¬Sutskere[4] Мбіцsequence to sequenceДЈРНЅвѕцУўУпµЅ·ЁУпµД·ТлОКМвЈ¬К№УГБЅёцLSTM ДЈРНЈ¬Т»ёцУГУЪ±аВлЈ¬Т»ёцУГУЪЅвВлЎЈёГДЈРНФКРнКдИлїЙ±ді¤¶ИЈ¬ТтОЄАґЧФ±аВлЖчµДКдіцЧЬКЗУіЙдµЅ№М¶ЁґуРЎµДПтБїЎЈКµК©µДЅб№ы±нГчУлSMTПµНіПаµ±ЎЈ

±ѕХВЅ«ЦчТЄО§ИЖОД±ѕЙъіЙјјКхЈ¬ЅйЙЬ»щ±ѕµДС»·ЙсѕНшВзДЈРНТФј°їЙРРµДјјКх·Ѕ°ёЎЈ

2.2 С»·ЙсѕНшВз

ЅьР©ДкЛжЧЕЙо¶ИЙсѕНшВзЈЁDeep Neural Network, DNNЈ©µДРЛЖрЈ¬С§ХЯГЗїЄКјіўКФК№УГС»·ЙсѕНшВз(Recurrent Neural NetworksЈ¬RNNs)ґ¦АнЧФИ»УпСФЙъіЙИООсЎЈФЪґ«НіµДЙсѕНшВзДЈРНЦРЈ¬КЗґУКдИлІгµЅТює¬ІгФЩµЅКдіцІгЈ¬ІгУлІгЦ®јдКЗИ«Б¬ЅУµДЈ¬јЩЙиЛщУРµДКдИлКЗП໥¶АБўµДЈ¬ЛщТФГїІгЦ®јдµДЅЪµгКЗОЮБ¬ЅУµДЈ¬µ«Хв¶ФУЪРн¶аNLPИООсАґЛµІўІ»КЗТ»ёцєГµДјЩЙиЈ¬АэИзЈ¬Ф¤ІвѕдЧУµДПВТ»ёцµҐґККЗКІГґЈ¬Т»°гРиТЄУГµЅЗ°ГжµДµҐґКЈ¬ТтОЄТ»ёцѕдЧУЦРЗ°єуµҐґКІўІ»КЗ¶АБўµДЎЈRNNsїЙТФ¶ФЗ°ГжµДРЕПўЅшРРјЗТдІўУ¦УГУЪµ±З°КдіцµДјЖЛгЦРЈ¬ХвСщТюІШІгµДКдИлІ»Ѕц°ьАЁКдИлІгµДКдіц»№°ьАЁЙПТ»К±їМТюІШІгµДКдіцЈ¬RNNsТСѕ±»Ц¤Гч¶ФNLPКЗ·ЗіЈіЙ№¦µДЈ¬ИзґКПтБї±нґпЎўУпѕдєП·ЁРФјмІйЎўґКРФ±кЧўµИЎЈ

ОД±ѕЙъіЙ±ѕЙнКЗТ»ёцРтБРКдіцОКМвЈ¬RNNїЙТФєЬєГµШїМ»ґК»гУлґК»гЦ®јдµДЗ°єу№ШБЄ№ШПµЈ¬±ѕЅЪЅйЙЬ»щ±ѕµДRNNДЈРНТФј°іЈјыRNNsµДНШХ№єНёДЅшДЈРНЎЈ

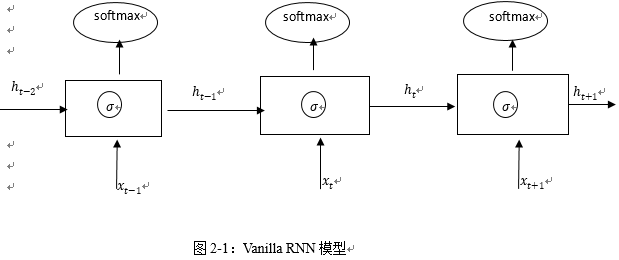

2.2.1 Vanilla RNN

АнВЫЙПЈ¬RNNДЬ№»¶ФИОєОі¤¶ИµДРтБРКэѕЭЅшРРґ¦АнЎЈµ«КЗФЪКµјщЦРЈ¬ЛьДЬјЗТдµДі¤¶ИКЗУРПЮµДЈ¬јтµҐµДRNNДЈРНґжФЪМЭ¶ИПыјхТФј°МЭ¶И±¬ХЁµДОКМвЈ¬НщНщДСТФСµБ·Ј¬ХвёцОКМвµД±ѕЦККЗУЙBPОуІо·ґПтґ«ІҐЛг·ЁТэЖрµДЈ¬·ґПтґ«ІҐЛг·ЁК№УГБґКЅ·ЁФтЈ¬ФЪЗуµјµДБґЙПМЭ¶И»бБ¬іЛЈ¬µ±КдИлУРЗбОў±д»ЇК±Ј¬СµБ·іцµДМЭ¶ИУРК±»бУРѕзБТ±д»ЇЈ¬НЁіЈЗйїцПВґуУЪ 1 µДКэБ¬іЛ»б±дґуЈ¬ј«¶ЛК±»бТэЖрМЭ¶И±¬ХЁЈ»РЎУЪ1 µДКэБ¬іЛ»б±дРЎЈ¬ј«¶ЛК±»бТэЖрМЭ¶ИПыК§ЎЈМЭ¶ИПыК§ТІ»бБоФЪС»·ЙсѕНшВзЦРЈ¬єуГжК±јдІЅµДРЕПў»бёІёЗЗ°ГжК±јдІЅµДРЕПўЎЈ

|

·ЦПнИГёь¶аИЛїґµЅ

НЖјцФД¶Б

Па№ШРВОЕ

їН»§¶ЛПВФШ

- ЖАВЫ

- №ШЧў

µЪТ»К±јдОЄДъНЖЛНИЁНюЧКС¶

µЪТ»К±јдОЄДъНЖЛНИЁНюЧКС¶

±ЁµАИ«Зт ґ«ІҐЦР№ъ

±ЁµАИ«Зт ґ«ІҐЦР№ъ

№ШЧўИЛГсНшЈ¬ґ«ІҐХэДЬБї

№ШЧўИЛГсНшЈ¬ґ«ІҐХэДЬБї